Digitale Holographie mit vielen Farben

Mithilfe spezieller Lichtquellen lassen sich dreidimensionale Form und Spektrum von Objekten ganz ohne fotografische Linsen aufzeichnen. Dahinter steckt eine besonders trickreiche Form der Interferenz in Raum und Zeit.

Ende der 1940er Jahre tüftelte der ungarische Physiker Dennis Gàbor daran, die Auflösung seines Elektronenmikroskops zu verbessern. Er überlegte, wie man die komplette Lichtinformation für die Bildgebung nutzen könnte. Gábor wollte nicht nur die Helligkeit des Lichts, sondern auch die Form der Wellenfronten aufzeichnen und wiedergeben. Damit schaffte er die Grundlage der Holografie: der Erzeugung dreidimensionaler Abbilder von Gegenständen.

Laser machen Hologramme möglich

In der Praxis waren Gàbors Versuche zunächst nur von mäßigem Erfolg gekrönt, denn die Lichtquellen, die ihm zur Verfügung standen, waren ungeeignet für sein Experiment. Erst nach der Erfindung des Lasers gelang es ab 1962, Hologramme aufzunehmen, aus denen sich dreidimensionale Bilder rekonstruieren ließen. Diese Bilder scheinen im Raum zu schweben und ermöglichen aus verschiedenen Richtungen betrachtet tatsächlich andere Blickwinkel auf ein Objekt. Für seine Pionierarbeit zur Holografie erhielt Gàbor 1971 den Physiknobelpreis.

Bei einem Hologramm handelt es sich um ein zweidimensionales Überlagerungsmuster, das alle Informationen über das Lichtfeld enthält, von dem es erzeugt wird. Das ist eben nicht nur die Intensität, sondern auch die Phase der Lichtwelle: Erreicht ein Wellenberg oder ein Wellental die Fotoplatte, oder etwas dazwischen? Um solche Interferenzmuster aufzuzeichnen, nutzt man in der Regel kohärentes Licht – also Licht, in dem die Wellenberge und -täler in einer festen Beziehung zueinanderstehen. Diese Voraussetzung erfüllt Laserlicht.

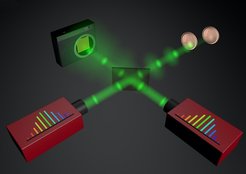

Um ein Hologramm aufzuzeichnen, wird das Laserlicht in zwei Strahlen aufgespalten: Einer beleuchtet das Objekt, der andere dient als Referenz für vom Objekt unbeeinflusstes Licht. Bei ihrer Überlagerung entsteht ein Muster, das Informationen über das Hindernis enthält, an dem der eine Strahl gestreut wurde. In der konventionellen Holografie wird dieses auf einem feinkörnigen fotografischen Film aufgezeichnet. Beleuchtet man das Interferenzbild später wieder mit dem leicht zu erzeugenden Referenzlicht, kann man ihm die Ursprungsinformationen entlocken. Die Lichtwellen laufen dann so weiter, als stünde das Objekt im Raum hinter dem Hologramm. Es entstehen die 3D-Bilder, die man von den Sicherheitselementen auf Ausweisen oder Kreditkarten kennt: Hier wird das Interferenzmuster auf eine Folie geprägt. Beim Betrachten im Licht erscheint ein dreidimensionales Bild.

Für spezielle Anwendungen tritt heute die digitale Holographie immer mehr in den Vordergrund. Hier werden die Interferenzmuster nicht auf Film, sondern mit einem digitalen Kamerasensor aufgezeichnet oder direkt von einem Computer berechnet. Für die Rekonstruktion gibt es räumliche Lichtmodulatoren, ähnlich winzigen Computer-Bildschirmen, die z.B. für augennahe Anzeigen bei Augmented-Reality-Anwendungen eingesetzt werden. Leider haben bisher weder die Kamerasensoren noch die digitalen Displays genügend Pixel, um bei der visuellen Darstellung dreidimensionaler Bilder mit traditionellem Film zu konkurrieren.

Räumliche Bilder sind nicht immer das Ziel

Interessanter ist es für viele Anwendungen, die digitalen Daten einer holografischen Aufnahme im Computer so auszuwerten, dass sich die dreidimensionale Struktur der Objekte aus den Interferenzmustern berechnen lässt. Der Computer übernimmt dabei gewissermaßen die Aufgabe der Referenzlichtquelle: als mathematische Transformation. Mit den so gewonnen 3D-Daten kann dann alles gemacht werden, was mit Computern auch sonst mit 3D-Objekten gut gelingt: Ansichten aus allen Richtungen und Abständen.

Allerdings beschränkt der Vorteil der Laser, Licht in nur genau einer Wellenlänge auszustrahlen, zwei wichtige Aspekte der Hologramme: Sie enthalten keine Farbinformation. Darüber hinaus ist die Information über die dritte Dimension – die Tiefe – nicht eindeutig: Man sieht dem Wellenberg nicht an, ob er genau am angenommenen Ort oder genau eine oder mehrere ganze Wellenlängen entfernt entstanden ist.

Der bunte Laserkamm

Ein neuartiges Verfahren, das beide Beschränkungen beseitigen kann, beruht auf einer ganz besonderen Lichtquelle: den Frequenzkämmen, einer Erfindung von Theodor Hänsch, Direktor am Max-Planck-Institut für Quantenoptik (MPQ), für die er 2005 mit dem Physik-Nobelpreis belohnt wurde.

Frequenzkämme verdanken ihren Namen dem Aussehen ihres Spektrums: Eine Alltagslampe etwa leuchtet in einem ganzen Wellenlängenbereich. Laserlicht hingegen zeigt sich als einzelne, scharfe Linie einer bestimmten Wellenlänge. Frequenzkämme enthalten viele solcher laserartigen Linien in regelmäßigem, definiertem Abstand – wie die Zinken eines Kamms. Um solches Licht zu erzeugen, verwendet man einen zeitlich sehr kurz gepulsten Laser. Die Dauer und Abfolge der Laserpulse bestimmen dabei das Aussehen des Kamms: Je kürzer die Pulse sind, desto breiter ist der vom Kamm überdeckte Wellenlängenbereich. Je langsamer die Pulsfolge ist, desto mehr Zinken entstehen.

Schwebungen wie bei der Gitarre

Mit solchen Frequenzkämmen lassen sich die Frequenzen anderer Laserquellen trickreich messen: Indem man einen Frequenzkamm mit einer anderen Lichtwelle überlagert, erhält man ein Auf- und Abschwellen der Amplitude, eine Schwebung. Wer schon mal eine Gitarre gestimmt hat, kennt dies als gut hörbares akustisches Auf und Ab. Es entsteht, wenn zwei Saiten fast, aber eben nicht ganz genau den gleichen Ton erzeugen. Die Frequenz der Schwebung entspricht dabei der Differenz der beiden beteiligten Frequenzen. So kann man hohe Frequenzen auf niedrigere – und damit messbare – reduzieren.

Diese Überlagerung funktioniert sogar mit zwei Frequenzkämmen: Ein Kurzpulslaser sendet dieses spezielle Licht mit regelmäßigen Frequenzabständen aus. Es trifft dann auf einen zweiten Frequenzkamm, in dem die Zacken etwas näher zusammen oder weiter auseinander stehen, der also minimal anders gepulst ist. Durch diesen Unterschied erhält man für jeden Zinken der Kämme eine Schwebung – ein sich zeitlich veränderndes Interferenzmuster. Und das steckt voller Informationen.

„Wir vereinen nun die Überlagerung des Lichts zweier Frequenzkämme mit der Holografie“, fasst Nathalie Picqué, die Erfinderin des Verfahrens, zusammen. Picqué und ihre Kollegen haben diese Methode entwickelt und im November 2021 in der Fachzeitschrift Nature Photonics erstmals beschrieben. Im Mai 2022 wurden Nathalie Picqué und ihr Kollege am Projekt, Eduardo Vicentini, für diese Erfindung außerde, mit dem Helmholtz-Preis für Metrologie ausgezeichnet.

Vier Dimensionen: Raum und Wellenlänge

Indem das Licht zweier unterschiedlich gepulster Frequenzkämme überlagert wird, entstehen räumliche Interferenzmuster für alle Zinken des Frequenzkamms. Das würde auch geschehen, wenn statt der Frequenzkämme beispielsweise das Licht eines roten und eines grünen Lasers gleichzeitig zur Beleuchtung benutzt würden. Die dabei entstehende zeitliche Interferenz wäre jedoch unmessbar schnell. Anders als beim Hologramm mit diesem normalen Laserlicht sind die Interferenzmuster der sich nur knapp unterscheidenden Kammfrequenzen zeitlich verhältnismäßig langsam variabel: Sie flimmern mit Frequenzen im Bereich einiger Schwingungen pro Sekunde. Das ist das optische Äquivalent zur Schwebung der knapp verstimmten Gitarrenseiten. „Aus den flimmernden Interferenzmustern berechnen wir einen Stapel von Hologrammen in verschiedenen Wellenlängen“, erklärt Picqué. „So erhalten wir das Verfahren der 4D-Holografie mit den drei räumlichen Dimensionen und der spektralen Information als vierter Dimension.“

Die MPQ-Forscherinnen und Forscher demonstrierten ihre Methode an zwei Münzen, deren 3D-Abbilder sie mithilfe der neuen Vielfarben-Holographie erstellten. Anders als bei der klassischen Holografie mussten sie dabei nicht mit der Doppeldeutigkeit der räumlichen Tiefe in Abständen der Wellenlänge leben. Dadurch, dass für jede Zinke der Frequenzkämme diese Doppeldeutigkeit bei einer anderen Länge auftritt, kann mathematisch ein viel größerer Entfernungsbereich eindeutig bestimmt werden. Picqué: „Mit diesem Verfahren kann man kleine und große Objekte nun berührungsfrei mit einer räumlichen Genauigkeit von Nanometern vermessen.“ Solch ein Messverfahren ist für die Materialprüfung und die Lebenswissenschaften sehr relevant.

Anwendungen mitgedacht

Die vierte Dimension, die sich aus dem Datensatz rekonstruieren lässt, ist das Spektrum des Lichts. Und auch damit ergibt sich das Potenzial für interessante Anwendungen: Wenn nämlich der Lichtweg durch ein Gas beeinflusst wird, dann entfernen die Gasmoleküle einen Teil des Spektrums. Dass dies in der Praxis funktioniert, zeigte das Team, indem Ammoniak in den Strahlengang eingebracht wurde. Und tatsächlich: „Genau an der erwarteten Wellenlänge nimmt die Intensität unseres Spektrums ab“, freut sich die Forscherin. „So konnten wir zeigen, dass unsere Methode auch zur Analyse von Gasproben dienen kann.“

Eine weitere wichtige Besonderheit des Verfahrens ist, dass es ohne Abbildungsoptik auskommt. Dadurch sind die Bilder nicht von Unschärfeeffekten aufgrund des Abstands zum Objektiv beeinflusst. Die Wirkung aller Brennweiten wird in einer einzigen Aufnahme ermittelt. Anders als bei klassischen Lichtmikroskopen etwa kann man aus den Daten am Computer später jede Bildebene herausschneiden und in voller Schärfe und mit voller Farbinformation am Bildschirm betrachten – und das mit einer Aufnahme, die nur wenige Sekunden in Anspruch nimmt.

Wohin geht die Reise mit der Doppel-Frequenzkamm-Holografie? „Mit Kameras höherer räumlicher und zeitlicher Auflösung – sprich, mehr Pixeln und schnellere Aufnahmen – können wir die Qualität weiter steigern“, blickt Nathalie Piqué in die Zukunft. Die Technik könnte dabei so weit miniaturisiert werden, dass sie auf ein A4-Blatt passt.